|

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

46

47

48

|

import numpy as np

import tensorflow as tf

from tensorflow.keras.models import Sequential

from tensorflow.keras.layers import Conv2D, MaxPooling2D, Flatten, Dense, Dropout

from keras.utils import to_categorical

from keras.datasets import mnist

import matplotlib.pyplot as plt

(x_train, y_train), (x_test, y_test) = mnist.load_data()

x_train = x_train.reshape(-1, 28, 28, 1)

x_test = x_test.reshape(-1, 28, 28, 1)

x_train = x_train.astype(np.float32)/255.0

x_test = x_test.astype(np.float32)/255.0

def make_model():

model = Sequential()

model.add(Conv2D(input_shape=(28, 28, 1), kernel_size=(3, 3), filters=32, activation='relu'))

model.add(Conv2D(kernel_size=(3, 3), filters=64, activation='relu'))

model.add(MaxPooling2D(pool_size=(2, 2)))

model.add(Dropout(0.2))

model.add(Flatten())

model.add(Dense(128, activation='relu'))

model.add(Dropout(0.2))

model.add(Dense(10, activation='softmax'))

return model

cnn_model = make_model()

cnn_model.compile(loss='sparse_categorical_crossentropy', optimizer=tf.keras.optimizers.Adam(), metrics=['accuracy'])

history = cnn_model.fit(x_train, y_train, validation_data=(x_test, y_test), batch_size=64, epochs=30)

cnn_model.evaluate(x_test, y_test)

plt.plot(history.history['accuracy'])

plt.plot(history.history['val_accuracy'])

plt.xlabel('epoch')

plt.ylabel('accuracy')

plt.legend(['train', 'validation'], loc='best')

plt.show()

|

cs |

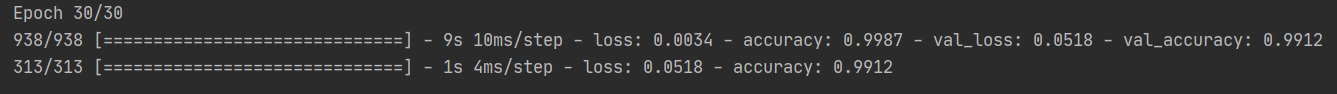

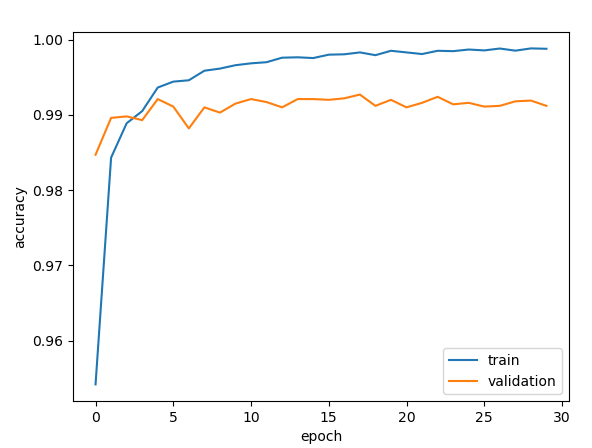

위 소스코드를 실행시키면 아래와 같은 결과를 얻을 수 있다.

기존 fully connected layer 기반의 인공신경망을 사용했을 때보다 성능이 더 높아진 것을 확인할 수 있다.

반응형

'머신러닝_딥러닝 > Tensorflow + Keras' 카테고리의 다른 글

| (Tensorflow 2.x) CNN 1탄 (With CIFAR-10 ) (0) | 2021.10.23 |

|---|---|

| (Tensorflow 2.x) Fashion MNIST (With CNN) (0) | 2021.10.23 |

| (Tensorflow 2.x) Classification (다중 분류) (0) | 2021.10.23 |

| (Tensorflow 2.x) Logistic Regression 2탄 (0) | 2021.10.23 |

| (Tensorflow 2.x) Logistic Regression 1탄 (0) | 2021.10.23 |