데이터셋 링크 : https://www.kaggle.com/asdasdasasdas/garbage-classification

|

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

46

47

48

49

50

51

52

53

54

55

56

57

58

59

60

61

62

63

64

65

66

67

68

69

70

71

72

73

74

75

76

77

78

79

80

81

82

83

84

85

86

87

88

89

90

91

92

93

94

95

96

97

98

99

100

101

102

103

104

105

106

107

108

109

110

111

112

113

114

115

116

117

118

119

120

121

122

123

124

125

126

127

128

129

130

131

132

133

134

135

136

137

138

139

140

141

142

143

144

145

146

147

148

149

150

151

152

153

154

155

156

157

158

159

160

161

162

163

164

165

166

167

168

169

170

171

172

173

174

175

176

177

178

179

180

181

182

183

184

185

186

187

188

|

import numpy as np

import tensorflow as tf

from tensorflow.keras.models import Sequential

from tensorflow.keras.layers import Conv2D, MaxPooling2D, Flatten, Dense, Dropout

from tensorflow.keras.datasets import cifar10

from tensorflow.keras.preprocessing.image import load_img, img_to_array, ImageDataGenerator

import matplotlib.pyplot as plt

import os, shutil

# 데이터셋 생성

dataset_dir = './data/Garbage classification/'

train_dir = os.path.join(dataset_dir, 'train')

os.mkdir(train_dir)

validation_dir = os.path.join(dataset_dir, 'val')

os.mkdir(validation_dir)

train_dir_cardboard = os.path.join(train_dir, 'cardboard')

os.mkdir(train_dir_cardboard)

train_dir_glass = os.path.join(train_dir, 'glass')

os.mkdir(train_dir_glass)

train_dir_metal = os.path.join(train_dir, 'metal')

os.mkdir(train_dir_metal)

train_dir_paper = os.path.join(train_dir, 'paper')

os.mkdir(train_dir_paper)

train_dir_plastic = os.path.join(train_dir, 'plastic')

os.mkdir(train_dir_plastic)

train_dir_trash = os.path.join(train_dir, 'trash')

os.mkdir(train_dir_trash)

validation_dir_cardboard = os.path.join(validation_dir, 'cardboard')

os.mkdir(validation_dir_cardboard)

validation_dir_glass = os.path.join(validation_dir, 'glass')

os.mkdir(validation_dir_glass)

validation_dir_metal = os.path.join(validation_dir, 'metal')

os.mkdir(validation_dir_metal)

validation_dir_paper = os.path.join(validation_dir, 'paper')

os.mkdir(validation_dir_paper)

validation_dir_plastic = os.path.join(validation_dir, 'plastic')

os.mkdir(validation_dir_plastic)

validation_dir_trash = os.path.join(validation_dir, 'trash')

os.mkdir(validation_dir_trash)

file_names = ['cardboard{}.jpg'.format(i) for i in range(1, 101)]

for file_name in file_names:

src = os.path.join(dataset_dir + '/cardboard', file_name)

dst = os.path.join(validation_dir_cardboard, file_name)

shutil.copyfile(src, dst)

file_names = ['glass{}.jpg'.format(i) for i in range(1, 101)]

for file_name in file_names:

src = os.path.join(dataset_dir + '/glass', file_name)

dst = os.path.join(validation_dir_glass, file_name)

shutil.copyfile(src, dst)

file_names = ['metal{}.jpg'.format(i) for i in range(1, 101)]

for file_name in file_names:

src = os.path.join(dataset_dir + '/metal', file_name)

dst = os.path.join(validation_dir_metal, file_name)

shutil.copyfile(src, dst)

file_names = ['paper{}.jpg'.format(i) for i in range(1, 101)]

for file_name in file_names:

src = os.path.join(dataset_dir + '/paper', file_name)

dst = os.path.join(validation_dir_paper, file_name)

shutil.copyfile(src, dst)

file_names = ['plastic{}.jpg'.format(i) for i in range(1, 101)]

for file_name in file_names:

src = os.path.join(dataset_dir + '/plastic', file_name)

dst = os.path.join(validation_dir_plastic, file_name)

shutil.copyfile(src, dst)

file_names = ['trash{}.jpg'.format(i) for i in range(1, 31)]

for file_name in file_names:

src = os.path.join(dataset_dir + '/trash', file_name)

dst = os.path.join(validation_dir_trash, file_name)

shutil.copyfile(src, dst)

file_names = ['cardboard{}.jpg'.format(i) for i in range(101, len(os.listdir(dataset_dir + '/cardboard')))]

for file_name in file_names:

src = os.path.join(dataset_dir + '/cardboard', file_name)

dst = os.path.join(train_dir_cardboard, file_name)

shutil.copyfile(src, dst)

file_names = ['glass{}.jpg'.format(i) for i in range(101, len(os.listdir(dataset_dir + '/glass')))]

for file_name in file_names:

src = os.path.join(dataset_dir + '/glass', file_name)

dst = os.path.join(train_dir_glass, file_name)

shutil.copyfile(src, dst)

file_names = ['metal{}.jpg'.format(i) for i in range(101, len(os.listdir(dataset_dir + '/metal')))]

for file_name in file_names:

src = os.path.join(dataset_dir + '/metal', file_name)

dst = os.path.join(train_dir_metal, file_name)

shutil.copyfile(src, dst)

file_names = ['paper{}.jpg'.format(i) for i in range(101, len(os.listdir(dataset_dir + '/paper')))]

for file_name in file_names:

src = os.path.join(dataset_dir + '/paper', file_name)

dst = os.path.join(train_dir_paper, file_name)

shutil.copyfile(src, dst)

file_names = ['plastic{}.jpg'.format(i) for i in range(101, len(os.listdir(dataset_dir + '/plastic')))]

for file_name in file_names:

src = os.path.join(dataset_dir + '/plastic', file_name)

dst = os.path.join(train_dir_plastic, file_name)

shutil.copyfile(src, dst)

file_names = ['trash{}.jpg'.format(i) for i in range(31, len(os.listdir(dataset_dir + '/trash')))]

for file_name in file_names:

src = os.path.join(dataset_dir + '/trash', file_name)

dst = os.path.join(train_dir_trash, file_name)

shutil.copyfile(src, dst)

train_gen = ImageDataGenerator(rotation_range=60, width_shift_range=0.3, shear_range=0.3,

horizontal_flip=True, zoom_range=0.3, rescale=1./255)

val_gen = ImageDataGenerator(rotation_range=60, width_shift_range=0.3, shear_range=0.3,

horizontal_flip=True, zoom_range=0.3, rescale=1./255)

train_generator = train_gen.flow_from_directory(train_dir, target_size=(240, 240), batch_size=32, class_mode='sparse')

validation_generator = train_gen.flow_from_directory(validation_dir, target_size=(240, 240), batch_size=32, class_mode='sparse')

# 모델 생성

def make_model():

model = Sequential()

model.add(Conv2D(input_shape=(240, 240, 3), kernel_size=(3, 3), filters=32, activation='relu'))

model.add(Conv2D(kernel_size=(3, 3), filters=32, activation='relu'))

model.add(MaxPooling2D(pool_size=(2, 2)))

model.add(Dropout(0.2))

model.add(Conv2D(kernel_size=(3, 3), padding='same', filters=64, activation='relu'))

model.add(MaxPooling2D(pool_size=(2, 2)))

model.add(Dropout(0.2))

model.add(Conv2D(kernel_size=(3, 3), filters=128, activation='relu'))

model.add(MaxPooling2D(pool_size=(2, 2)))

model.add(Dropout(0.2))

model.add(Conv2D(kernel_size=(3, 3), filters=128, activation='relu'))

model.add(MaxPooling2D(pool_size=(2, 2)))

model.add(Dropout(0.2))

model.add(Flatten())

model.add(Dense(128, activation='relu'))

model.add(Dropout(0.2))

model.add(Dense(6, activation='softmax'))

return model

model = make_model()

# 모델 컴파일 및 훈련시키기

model.compile(loss='sparse_categorical_crossentropy', optimizer=tf.keras.optimizers.Adam(), metrics=['accuracy'])

history = model.fit_generator(train_generator, steps_per_epoch=10, epochs=200,

validation_data=validation_generator, validation_steps=10)

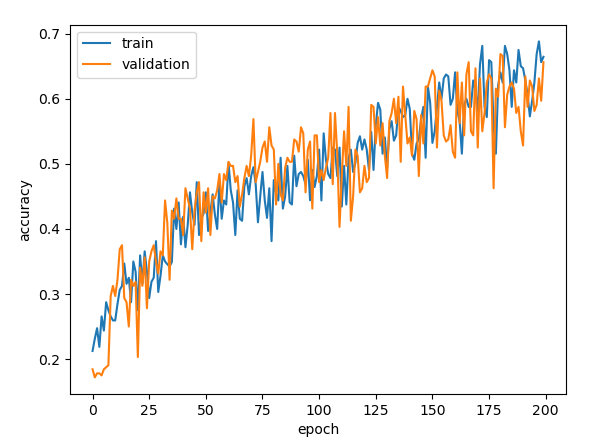

# 훈련의 정확도 확인

plt.plot(history.history['accuracy'])

plt.plot(history.history['val_accuracy'])

plt.xlabel('epoch')

plt.ylabel('accuracy')

plt.legend(['train', 'validation'], loc='best')

plt.show()

|

cs |

위 소스코드를 실행시키면 아래와 같은 출력값을 얻을 수 있다.

반응형

'머신러닝_딥러닝 > Tensorflow + Keras' 카테고리의 다른 글

| (Tensorflow 2.x) 함수형 API (0) | 2021.10.23 |

|---|---|

| (Tensorflow 2.x) CNN 3탄 (Transfer Learning) (0) | 2021.10.23 |

| (Tensorflow 2.x) CNN 1탄 (With CIFAR-10 ) (0) | 2021.10.23 |

| (Tensorflow 2.x) Fashion MNIST (With CNN) (0) | 2021.10.23 |

| (Tensorflow 2.x) MNIST (With CNN) (0) | 2021.10.23 |